Python深度学习 人工神经网络

人工神经网络,或简称神经网络,并不是一个新概念。它已经存在了大约80年。

直到 2011 年,深度神经网络才开始流行起来,因为它使用了新技术、巨大的数据集可用性和强大的计算机。

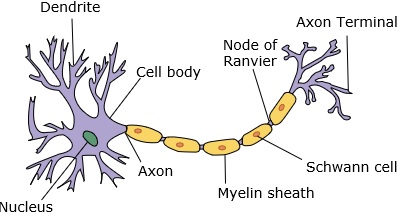

神经网络模仿具有树突、细胞核、轴突和末端轴突的神经元。

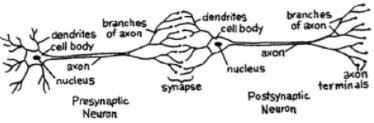

对于一个网络,我们需要两个神经元。这些神经元通过一个树突和另一个末端轴突之间的突触传递信息。

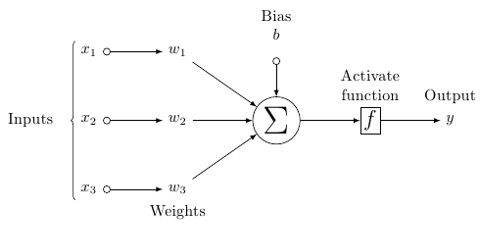

一个人工神经元的可能模型如下所示:

一个神经网络如下图所示:

圆圈是神经元或节点,它们在数据上的功能和连接它们的线/边是传递的权重/信息。

每列是一层。数据的第一层是输入层。然后,输入层和输出层之间的所有层都是隐藏层。

如果你有一个或几个隐藏层,那么你就有了一个浅层神经网络。如果你有很多隐藏层,那么你就有了一个深度神经网络。

在这个模型中,你有输入数据,你给它加权,然后将它传递给神经元中称为阈值函数或激活函数的函数。

基本上,它是与某个值比较后所有值的总和。如果你发出一个信号,那么结果是 (1) 输出,或者什么都没有发出,那么结果是 (0)。然后将其加权并传递给下一个神经元,并运行相同类型的函数。

我们可以有一个 sigmoid(s 形)函数作为激活函数。

至于权重,它们只是随机开始,并且每个节点/神经元的输入都是唯一的。

在典型的“前馈”(最基本的神经网络类型)中,你的信息直接通过你创建的网络传递,并将输出与你希望输出使用样本数据的结果进行比较。

从这里开始,你需要调整权重以帮助你获得与所需输出相匹配的输出。

直接通过神经网络发送数据的行为称为 前馈神经网络。

我们的数据按顺序从输入到层,然后到输出。

当我们倒退并开始调整权重以最小化损失/成本时,这被称为 反向传播。

这是个 优化问题。 使用神经网络,在实际实践中,我们必须处理数十万或数百万甚至更多的变量。

第一个解决方案是使用随机梯度下降作为优化方法。现在,有 AdaGrad、Adam Optimizer 等选项。无论哪种方式,这都是一个大规模的计算操作。这就是为什么神经网络大多被搁置了半个多世纪。直到最近,我们的机器才有能力和架构来考虑执行这些操作,以及匹配大小合适的数据集。

对于简单的分类任务,神经网络在性能上与其他简单算法(如 K 最近邻)相对接近。当我们拥有更大的数据和更复杂的问题时,神经网络的真正效用才能实现,这两者都优于其他机器学习模型。