Sqoop 安装

由于 Sqoop 是 Hadoop 的一个子项目,它只能在 Linux 操作系统上运行。按照下面给出的步骤在你的系统上安装 Sqoop。

第 1 步:验证 JAVA 安装

在安装 Sqoop 之前,你需要在系统上安装 Java。让我们使用以下命令验证 Java 安装:

$ java –version

如果你的系统上已经安装了 Java,你会看到以下响应:

java version "1.7.0_71" Java(TM) SE Runtime Environment (build 1.7.0_71-b13) Java HotSpot(TM) Client VM (build 25.0-b02, mixed mode)

如果你的系统上未安装 Java,请按照以下步骤操作。

安装 Java

按照下面给出的简单步骤在你的系统上安装 Java。

步骤 1

通过访问以下网址下载 Java(JDK <最新版本> - X64.tar.gz) link .

然后 jdk-7u71-linux-x64.tar.gz 将被下载到你的系统上。

步骤 2

通常,你可以在 Downloads 文件夹中找到下载的 Java 文件。验证它并使用以下命令提取 jdk-7u71-linux-x64.gz 文件。

$ cd Downloads/ $ ls jdk-7u71-linux-x64.gz $ tar zxf jdk-7u71-linux-x64.gz $ ls jdk1.7.0_71 jdk-7u71-linux-x64.gz

步骤 3

要使所有用户都可以使用 Java,你必须将其移动到“/usr/local/”位置。打开 root,然后键入以下命令。

$ su password: # mv jdk1.7.0_71 /usr/local/java # exit步骤 IV:

步骤 4

要设置 PATH 和 JAVA_HOME 变量,请将以下命令添加到 ~/.bashrc 文件中。

export JAVA_HOME=/usr/local/java export PATH=$PATH:$JAVA_HOME/bin

现在将所有更改应用到当前正在运行的系统中。

$ source ~/.bashrc

步骤 5

使用以下命令配置 Java 替代品:

# alternatives --install /usr/bin/java java usr/local/java/bin/java 2 # alternatives --install /usr/bin/javac javac usr/local/java/bin/javac 2 # alternatives --install /usr/bin/jar jar usr/local/java/bin/jar 2 # alternatives --set java usr/local/java/bin/java # alternatives --set javac usr/local/java/bin/javac # alternatives --set jar usr/local/java/bin/jar

现在使用命令验证安装 java版本 如上所述从终端。

第 2 步:验证 Hadoop 安装

在安装 Sqoop 之前,必须在你的系统上安装 Hadoop。让我们使用以下命令验证 Hadoop 安装:

$ hadoop version

如果你的系统上已经安装了 Hadoop,那么你将收到以下响应:

Hadoop 2.4.1 -- Subversion https:// svn.apache.org/repos/asf/hadoop/common -r 1529768 Compiled by hortonmu on 2013-10-07T06:28Z Compiled with protoc 2.5.0 From source with checksum 79e53ce7994d1628b240f09af91e1af4

如果你的系统上未安装 Hadoop,则继续执行以下步骤:

下载 Hadoop

使用以下命令从 Apache Software Foundation 下载并提取 Hadoop 2.4.1。

$ su password: # cd /usr/local # wget http:// apache.claz.org/hadoop/common/hadoop-2.4.1/ hadoop-2.4.1.tar.gz # tar xzf hadoop-2.4.1.tar.gz # mv hadoop-2.4.1/* to hadoop/ # exit

以伪分布式模式安装 Hadoop

按照下面给出的步骤以伪分布式模式安装 Hadoop 2.4.1。

第 1 步:设置 Hadoop

你可以通过将以下命令附加到 ~/.bashrc 文件来设置 Hadoop 环境变量。

export HADOOP_HOME=/usr/local/hadoop export HADOOP_MAPRED_HOME=$HADOOP_HOME export HADOOP_COMMON_HOME=$HADOOP_HOME export HADOOP_HDFS_HOME=$HADOOP_HOME export YARN_HOME=$HADOOP_HOME export HADOOP_COMMON_LIB_NATIVE_DIR=$HADOOP_HOME/lib/native export PATH=$PATH:$HADOOP_HOME/sbin:$HADOOP_HOME/bin

现在,将所有更改应用到当前正在运行的系统中。

$ source ~/.bashrc

第 2 步:Hadoop 配置

你可以在“$HADOOP_HOME/etc/hadoop”位置找到所有 Hadoop 配置文件。你需要根据你的 Hadoop 基础架构对这些配置文件进行适当的更改。

$ cd $HADOOP_HOME/etc/hadoop

为了使用 java 开发 Hadoop 程序,你必须重置 java 环境变量 hadoop-env.sh 通过将 JAVA_HOME 值替换为系统中 java 的位置来创建文件。

export JAVA_HOME=/usr/local/java

下面给出了你需要编辑以配置 Hadoop 的文件列表。

核心站点.xml

core-site.xml 文件包含诸如用于 Hadoop 实例的端口号、为文件系统分配的内存、存储数据的内存限制以及读/写缓冲区的大小等信息。

打开 core-site.xml 并在

<configuration> <property> <name>fs.default.name</name> <value>hdfs:// 本地主机:9000 </property> </configuration>

hdfs-site.xml

hdfs-site.xml 文件包含复制数据的值、namenode 路径和本地文件系统的 datanode 路径等信息。这意味着你要存储 Hadoop 基础架构的地方。

让我们假设以下数据。

dfs.replication (data replication value) = 1 (In the following path /hadoop/ is the user name. hadoopinfra/hdfs/namenode is the directory created by hdfs file system.) namenode path = // 主页/hadoop/hadoopinfra/hdfs/namenode (hadoopinfra/hdfs/datanode is the directory created by hdfs file system.) datanode path = // 主页/hadoop/hadoopinfra/hdfs/datanode

打开此文件并在此文件的

<configuration> <property> <name>dfs.replication</name> <value>1</value> </property> <property> <name>dfs.name.dir</name> <value>file:// /home/hadoop/hadoopinfra/hdfs/namenode </property> <property> <name>dfs.data.dir</name> <value>file:// /home/hadoop/hadoopinfra/hdfs/datanode </property> </configuration>

注意 : 在上面的文件中,所有的属性值都是用户定义的,你可以根据你的Hadoop基础设施进行更改。

纱线站点.xml

该文件用于将 yarn 配置到 Hadoop 中。打开 yarn-site.xml 文件并在该文件的

<configuration> <property> <name>yarn.nodemanager.aux-services</name> <value>mapreduce_shuffle</value> </property> </configuration>

mapred-site.xml

该文件用于指定我们使用的 MapReduce 框架。默认情况下,Hadoop 包含一个 yarn-site.xml 模板。首先,你需要使用以下命令将文件从 mapred-site.xml.template 复制到 mapred-site.xml 文件。

$ cp mapred-site.xml.template mapred-site.xml

打开 mapred-site.xml 文件并在此文件的

<configuration> <property> <name>mapreduce.framework.name</name> <value>yarn</value> </property> </configuration>

验证 Hadoop 安装

以下步骤用于验证 Hadoop 安装。

第 1 步:名称节点设置

使用命令“hdfs namenode -format”设置名称节点,如下所示。

$ cd ~ $ hdfs namenode -format

预期结果如下。

10/24/14 21现在,将所有更改应用到当前正在运行的系统中。55 INFO namenode.NameNode: STARTUP_MSG: /************************************************************ STARTUP_MSG: Starting NameNode STARTUP_MSG: host = localhost/192.168.1.11 STARTUP_MSG: args = [-format] STARTUP_MSG: version = 2.4.1 ... ... 10/24/14 21现在,将所有更改应用到当前正在运行的系统中。56 INFO common.Storage: Storage directory /home/hadoop/hadoopinfra/hdfs/namenode has been successfully formatted. 10/24/14 21现在,将所有更改应用到当前正在运行的系统中。56 INFO namenode.NNStorageRetentionManager: Going to retain 1 images with txid >= 0 10/24/14 21现在,将所有更改应用到当前正在运行的系统中。56 INFO util.ExitUtil: Exiting with status 0 10/24/14 21现在,将所有更改应用到当前正在运行的系统中。56 INFO namenode.NameNode: SHUTDOWN_MSG: /************************************************************ SHUTDOWN_MSG: Shutting down NameNode at localhost/192.168.1.11 ************************************************************/

第 2 步:验证 Hadoop dfs

以下命令用于启动 dfs。执行此命令将启动你的 Hadoop 文件系统。

$ start-dfs.sh

预期输出如下:

10/24/14 21核心站点.xml56 Starting namenodes on [localhost] localhost: starting namenode, logging to /home/hadoop/hadoop- 2.4.1/logs/hadoop-hadoop-namenode-localhost.out localhost: starting datanode, logging to /home/hadoop/hadoop- 2.4.1/logs/hadoop-hadoop-datanode-localhost.out Starting secondary namenodes [0.0.0.0]

第 3 步:验证 Yarn 脚本

以下命令用于启动 yarn 脚本。执行此命令将启动你的纱线守护进程。

$ start-yarn.sh

预期输出如下:

starting yarn daemons starting resourcemanager, logging to /home/hadoop/hadoop- 2.4.1/logs/yarn-hadoop-resourcemanager-localhost.out localhost: starting node manager, logging to /home/hadoop/hadoop- 2.4.1/logs/yarn-hadoop-nodemanager-localhost.out

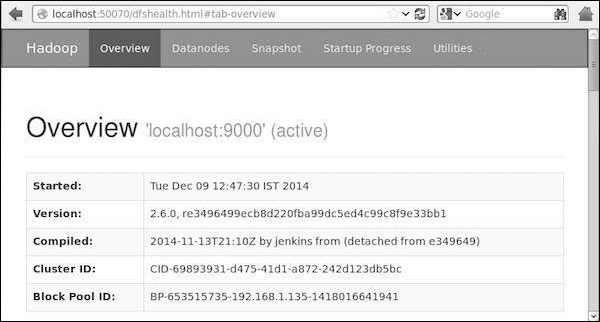

第 4 步:在浏览器上访问 Hadoop

访问 Hadoop 的默认端口号是 50070。使用以下 URL 在浏览器上获取 Hadoop 服务。

http:// 本地主机:50070/

下图描绘了 Hadoop 浏览器。

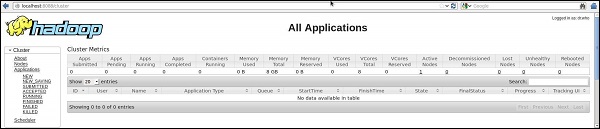

第 5 步:验证集群的所有应用程序

访问集群所有应用的默认端口号为8088。使用以下url访问该服务。

http:// 本地主机:8088/

下图描述了 Hadoop 集群浏览器。

第 3 步:下载 Sqoop

我们可以从下面下载最新版本的 Sqoop link 对于本教程,我们使用的是 1.4.5 版本,即 sqoop-1.4.5.bin__hadoop-2.0.4-alpha.tar.gz .

第 4 步:安装 Sqoop

以下命令用于提取 Sqoop tar 球并将其移动到“/usr/lib/sqoop”目录。

$tar -xvf sqoop-1.4.4.bin__hadoop-2.0.4-alpha.tar.gz $ su password: # mv sqoop-1.4.4.bin__hadoop-2.0.4-alpha /usr/lib/sqoop #exit

第 5 步:配置 bashrc

你必须通过将以下行附加到 ~/ 来设置 Sqoop 环境 .bashrc file:

#Sqoop export SQOOP_HOME=/usr/lib/sqoop export PATH=$PATH:$SQOOP_HOME/bin

以下命令用于执行~/ .bashrc file.

$ source ~/.bashrc

第 6 步:配置 Sqoop

要使用 Hadoop 配置 Sqoop,你需要编辑 sqoop-env.sh 文件,该文件位于 $SQOOP_HOME/conf 目录。首先,重定向到 Sqoop config 目录并使用以下命令复制模板文件:

$ cd $SQOOP_HOME/conf $ mv sqoop-env-template.sh sqoop-env.sh

Open sqoop-env.sh 并编辑以下行:

export HADOOP_COMMON_HOME=/usr/local/hadoop export HADOOP_MAPRED_HOME=/usr/local/hadoop

第 7 步:下载并配置 mysql-connector-java

我们可以下载 mysql-connector-java-5.1.30.tar.gz 从以下文件 link .

以下命令用于提取 mysql-connector-java tarball 并移动 mysql-connector-java-5.1.30-bin.jar 到 /usr/lib/sqoop/lib 目录。

$ tar -zxf mysql-connector-java-5.1.30.tar.gz $ su password: # cd mysql-connector-java-5.1.30 # mv mysql-connector-java-5.1.30-bin.jar /usr/lib/sqoop/lib

第 8 步:验证 Sqoop

以下命令用于验证 Sqoop 版本。

$ cd $SQOOP_HOME/bin $ sqoop-version

预期输出:

14/12/17 14mapred-site.xml32 INFO sqoop.Sqoop: Running Sqoop version: 1.4.5 Sqoop 1.4.5 git commit id 5b34accaca7de251fc91161733f906af2eddbe83 Compiled by abe on Fri Aug 1 11在安装 Sqoop 之前,必须在你的系统上安装 Hadoop。让我们使用以下命令验证 Hadoop 安装:26 PDT 2014

Sqoop 安装完成。